「人間の仕事の多くが、いずれAIに奪われてしまう」という話。

皆さんはどう感じているでしょうか。

筆者はこの話題について「半分は本当で、もう半分はまだ現実味はない」と考えています。

なぜそう考えるのか。

今回は、AIはどのような形で人の仕事に介入し、またAIに苦手な仕事を任せると何が起きるのかを見ていきましょう。

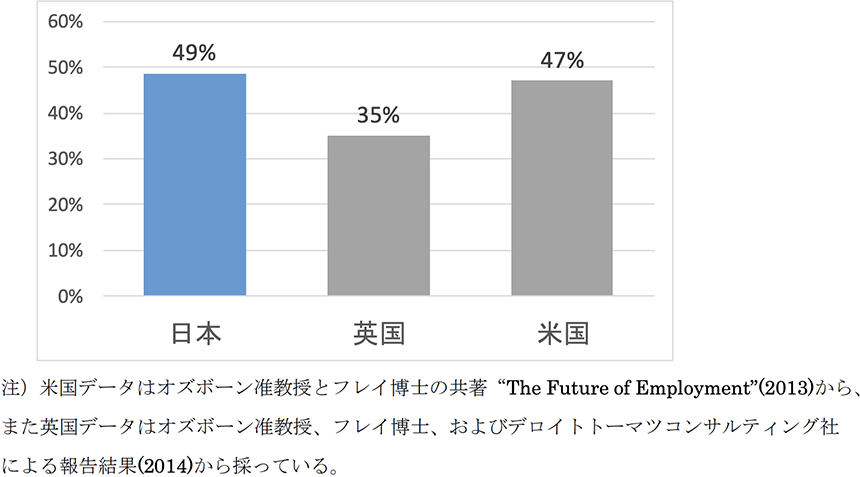

日本人の半分がAIやロボットに仕事を奪われる?

まずは、野村総合研究所が2015年にリリースしたニュースからおさらいしていきましょう。

オックスフォード大学と同社が共同で実施した研究によると、10~20年後には日本の労働人口の約49%が、技術的にはAIやロボットで代替可能になるというというのがその趣旨です(図1)。

数字だけを見ると、少しショッキングな結果でもあります。しかし一方で筆者は、「AI神話」の行き過ぎを時々感じます。

AIは、そんなに完璧な存在なのでしょうか?

AI搭載ロボットにバッテリーを取りに行かせてみたら

AIは人間よりも多くのことを記憶できますし、計算速度も圧倒的に速いものです。

しかし一方でAIにも弱点があり、そのうちの1つが「フレーム問題」と呼ばれるものです。

AIは「覚える」ことが得意でも、「無視する」ことが苦手なようです。

このような実験があります*1。

AIを搭載したロボットに「別室にある自分の予備バッテリーを取りに行かせる」というものです。

しかし、ただ単にバッテリーを持ってくるだけではありません。

- バッテリーは部屋の中にあり、ワゴンに乗せられている

- ワゴンには時限爆弾も一緒に乗っている

さて、皆さんはどうやってバッテリーを持ち出すでしょうか。

部屋に入り、ワゴンの上から時限爆弾だけを取り出して床に置き、バッテリーだけを載せたワゴンを部屋から持ち出してくる、と考えることでしょう。

しかし初号機「R1」は、ワゴンと一緒に爆弾も持ち出してしまいました。「バッテリーを部屋から出す」ということを素直に実行してしまった結果です。

そこで研究者たちは、自分が行動すると何かしらの副産物が生まれるということを教えたロボット「R1D1」を作りました。その結果はこのようなものです。

R1D1も、PULLOUT (WAGON,ROOM)を考えついた。それからR1D1は、設計されたとおり、この行動の帰結を考え始めた。R1D1は、ワゴンを部屋から引っぱり出しても部屋の壁の色は変わらないということを演縛し、ワゴンを引けば車輪が回転するだろうという帰結の証明にとりかかった。そのとき爆弾は爆発した。

もちろん、入るべき部屋の特徴として色を知ることは必須です。しかし、ここではワゴンとは無関係です。

しかし、これら全く関係のない要素を結びつけ、重要事項のひとつとして考えてしまったのです。

そこで研究者たちは「関係のあること」「関係のないこと」を区別するように教えた「R2D1」を開発しました。すると、このような事態に陥ってしまったのです。

すると、驚いたことに、 このロボットは、部屋に入ろうともせず、 じっとうずくまって考えていた。設計者たちは 「何かしろ」 と叫んだ。R2D1は 「してますよ」 と答えた。 「私は、無関係な帰結を探し出してそれを無視するのに忙しいんです。そんな帰結が何千とあるんです。私は、関係のない帰結を見つけると、すぐそれを無視しなければならないもののリストにのせて、 ……」

また爆発してしまった。

なんともシュールな結末です。

多くのことを知りすぎてしまったために、あまりにも多すぎる可能性をひとつずつ検証している間に時間が過ぎた、というものです。

私たち人間が業務をするとき、「無視して良いもの」「最優先のもの」というのは「暗黙の了解」の中にあります。「このあたりは大雑把でも良いが、ここは間違えてはいけない」という塩梅も、人間だから分かることと言えます。

しかしAIはまだ「暗黙の了解」を持っていないのです。

「AIで地動説は生まれない」

さて、IT界の「天才少年」として知られる人物がいます。

インド出身のタンメイ・バクシ氏は5歳からプログラミングを始め、9歳の時にはiOSでアプリを開発してアップルストアに認められました。その後、IBMの人工知能開発にも携わっています*2。

彼の持論は、AIとは「機械学習」であって「知能」ではないということです。「AIで地動説は生まれない」ということをスピーチで重ねて語っています。

タンメイ君は、「人間の『Innovation(革新)』は、何よりも、人間の好奇心から始まる」と説いている。そして、「機械学習で『天動説』を否定できても、『地動説』を考え付くことは出来ない」と考えている。

ニュートンが万有引力の法則を見いだしたことにも似ています。

ニュートンはリンゴが木から落ちる様子を見て万有引力の法則を思いついたということですが、これがAIだったらどうなるでしょう。

「リンゴは丸い」「リンゴは木から落ちる物体である」「このときは時速何分で落ちた」「リンゴが木から落ちる速度の平均値はこれである」「リンゴの木の平均的な高さは何メートルである」。

そのような計算はいくらでもできるかもしれません。

しかし、リンゴの落下風景を何度見せても、AIは「地球がリンゴを引っ張っている」というアイデアにはたどり着かないのです。与えられたパターンやデータの外側には、AIはたどり着くことができません。

AIと共存するスキルを

ここまで見てきたように、AIはどれだけの記憶力や計算力を持っていても、それ自身が「発明」をするものではありません。

また、AIの「先生」が間違ったことを教えてしまえば、AIもまた間違った計算や判断をしてしまいますし、先生が教えられないことは学べません。

AIには元データが必要であり、人間が一切関わらずに人間の想像を超えたものを生むことはできないのです。

ですから、「人間はAIに勝てない」というのは半分間違っていると筆者は考えています。

また、少なくとも上記の実験のようなロボットには、危機管理は任せられそうにありません。

AIを何か「突然やってきた、自分たちを脅かすもの」「自分よりもはるかに正しい存在」と考えてしまうことは、不戦敗を意味します。

そうならないように、まずは「相手を知る」ことから始めてみませんか?

*1:「『フレーム問題』の解消:人工知能研究への一低減:P14」京都大学学術情報リポジトリ

*2:「少年プログラマー タンメイ・バクシの原点は父の姿」日経xwoman